TruthArchive.ai - Tweets Saved By @jeffpillou

@jeffpillou - Jean-François Pillou

Le gouvernement (service PEReN) a publié un document pédagogique décrivant comme fonctionnent les IA conversationnelles comme ChatGPT #GPT4, en voici une synthèse rapide. 1/9

@jeffpillou - Jean-François Pillou

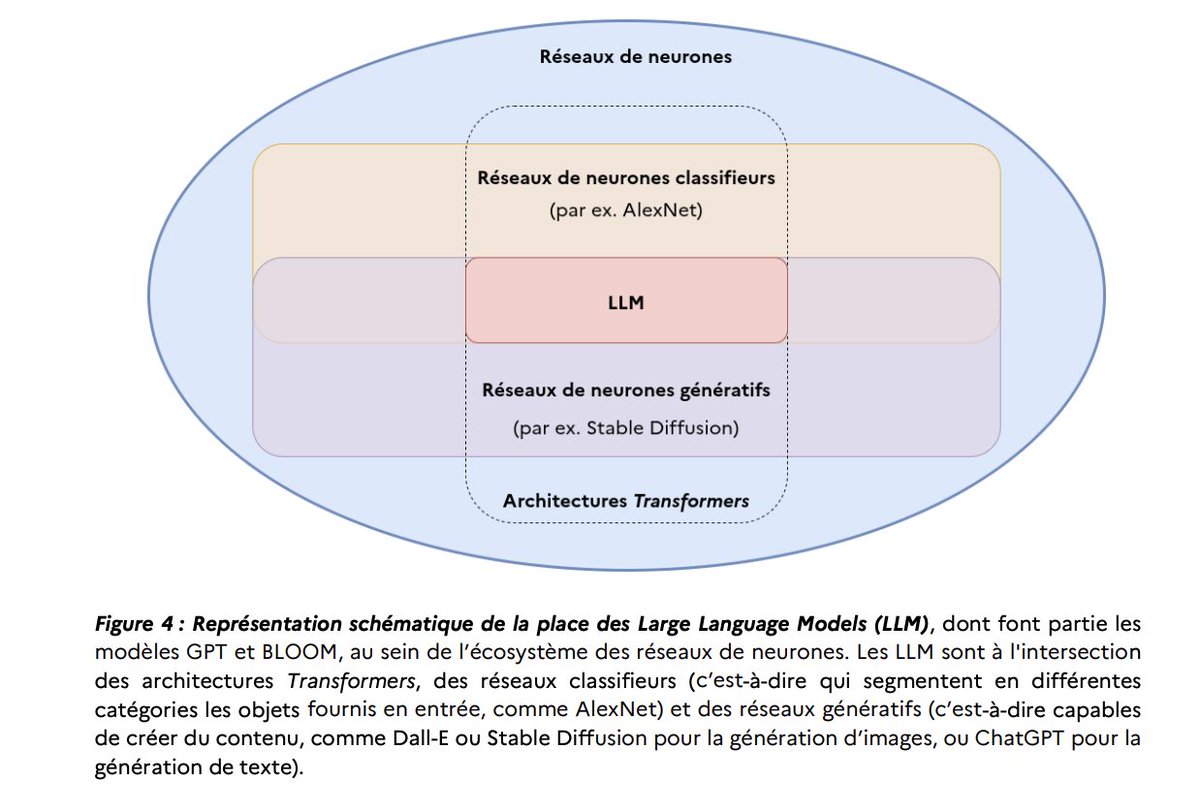

Les Large Language Models (LLM) sont d'impressionnants réseaux de neurones qui révolutionnent le Traitement Automatique des Langues (TAL ou NLP). Ce sont des modèles statistiques qui imitent le fonctionnement du cerveau humain pour traiter et comprendre le langage. #NLP 2/9

@jeffpillou - Jean-François Pillou

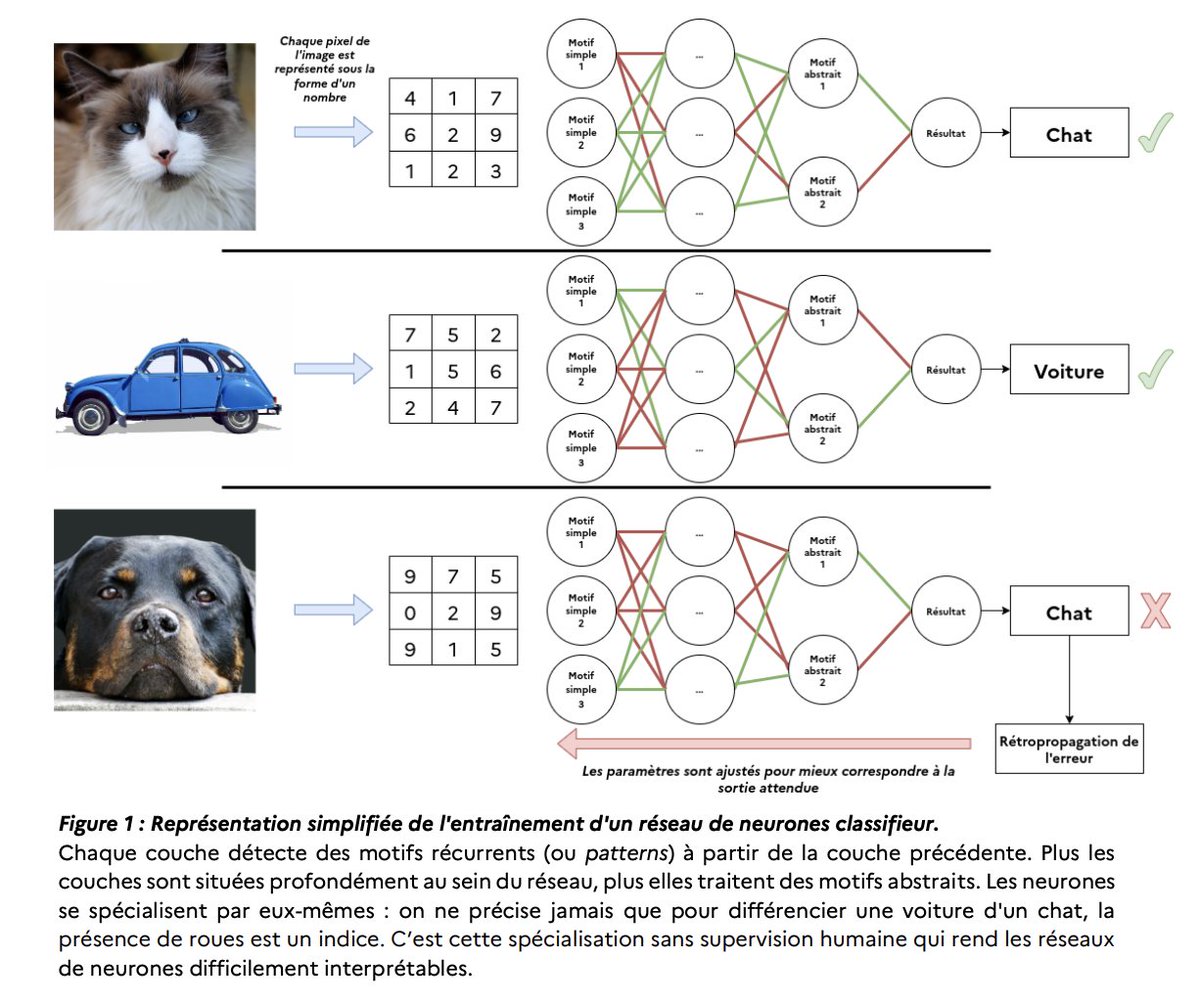

Les réseaux de neurones sont structurés en couches, chaque couche détectant des motifs récurrents (patterns) dans les données. Les neurones contiennent des paramètres qui sont ajustés au cours de l'entraînement pour améliorer les performances. #MachineLearning 3/9

@jeffpillou - Jean-François Pillou

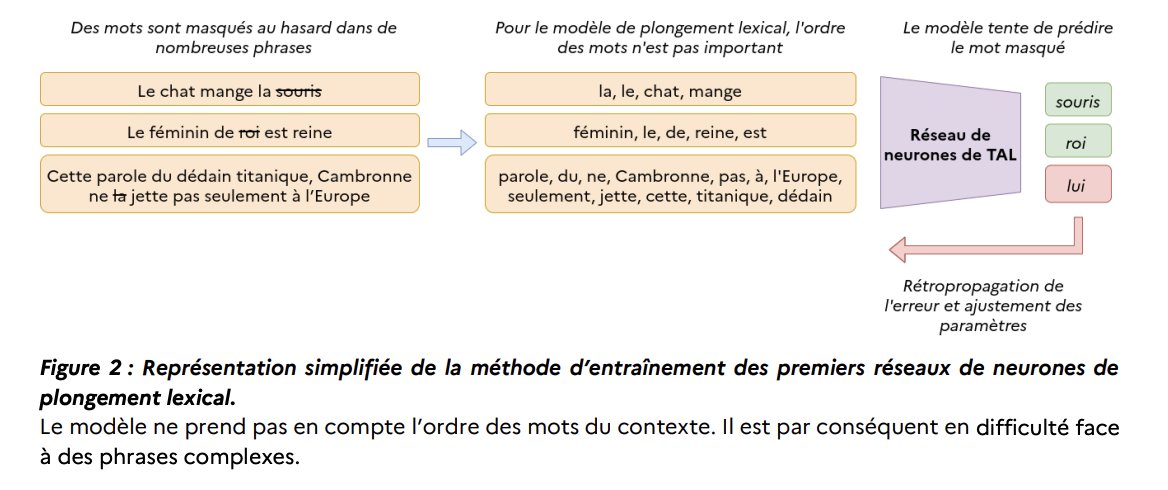

📚 Le NLP a connu de nombreuses avancées grâce aux réseaux de neurones, comme le plongement lexical (word embedding) qui permet de représenter les mots mathématiquement et de réaliser des opérations sur ces représentations. #WordEmbedding 4/9

@jeffpillou - Jean-François Pillou

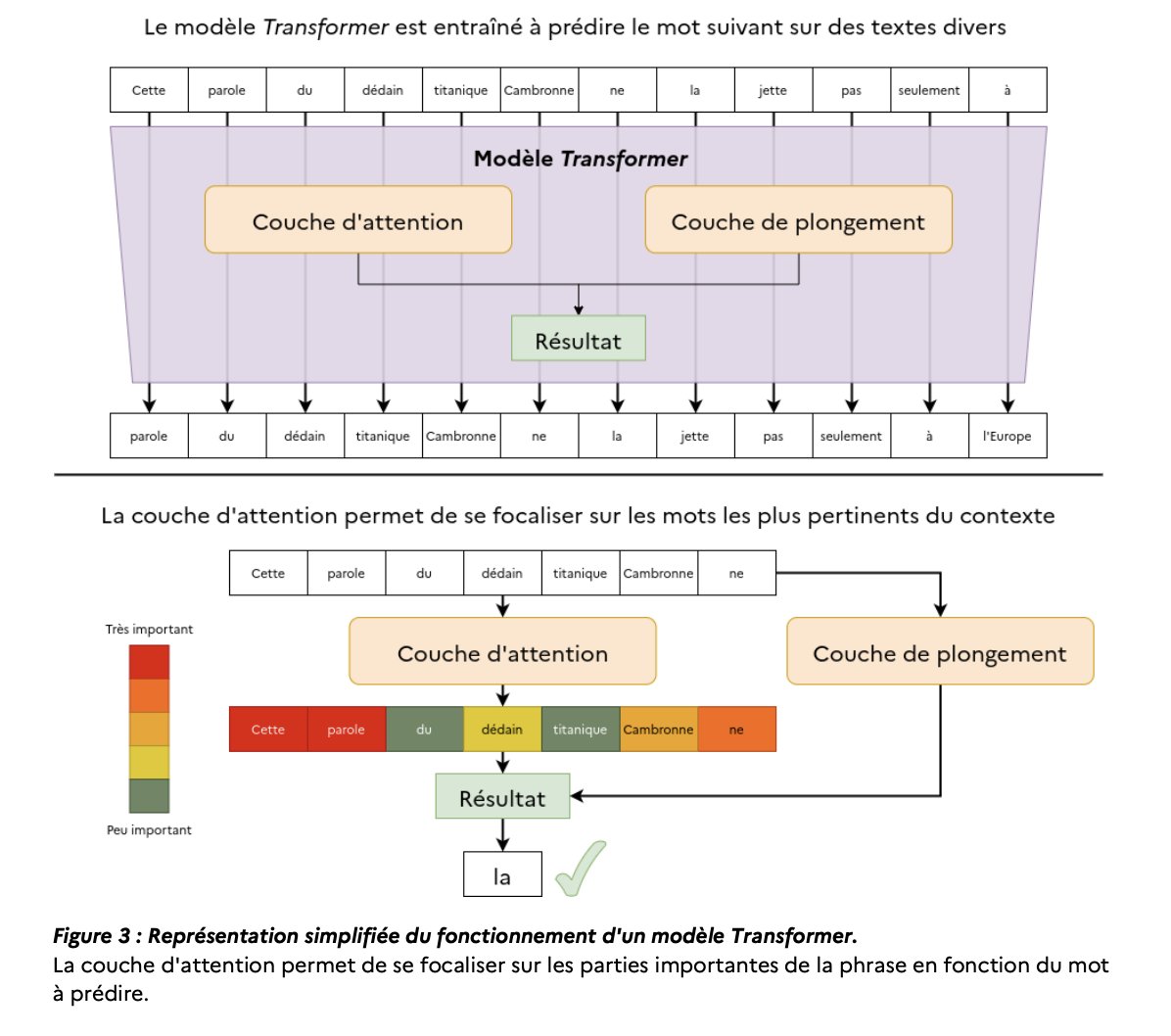

Le mécanisme de l'attention a été une autre innovation majeure. Il permet aux modèles de se concentrer sur les mots importants dans le contexte d'une phrase, résolvant ainsi le problème des phrases complexes. Cela a conduit à la création d'architectures "Transformers". 5/9

@jeffpillou - Jean-François Pillou

Les LLM, tels que GPT et BERT, sont basés sur les architectures Transformers. Leur entraînement nécessite de grandes quantités de données textuelles (comme des pages Web ou des livres) et est coûteux en temps, en matériel et en énergie. #Transformers #GPT 6/9

@jeffpillou - Jean-François Pillou

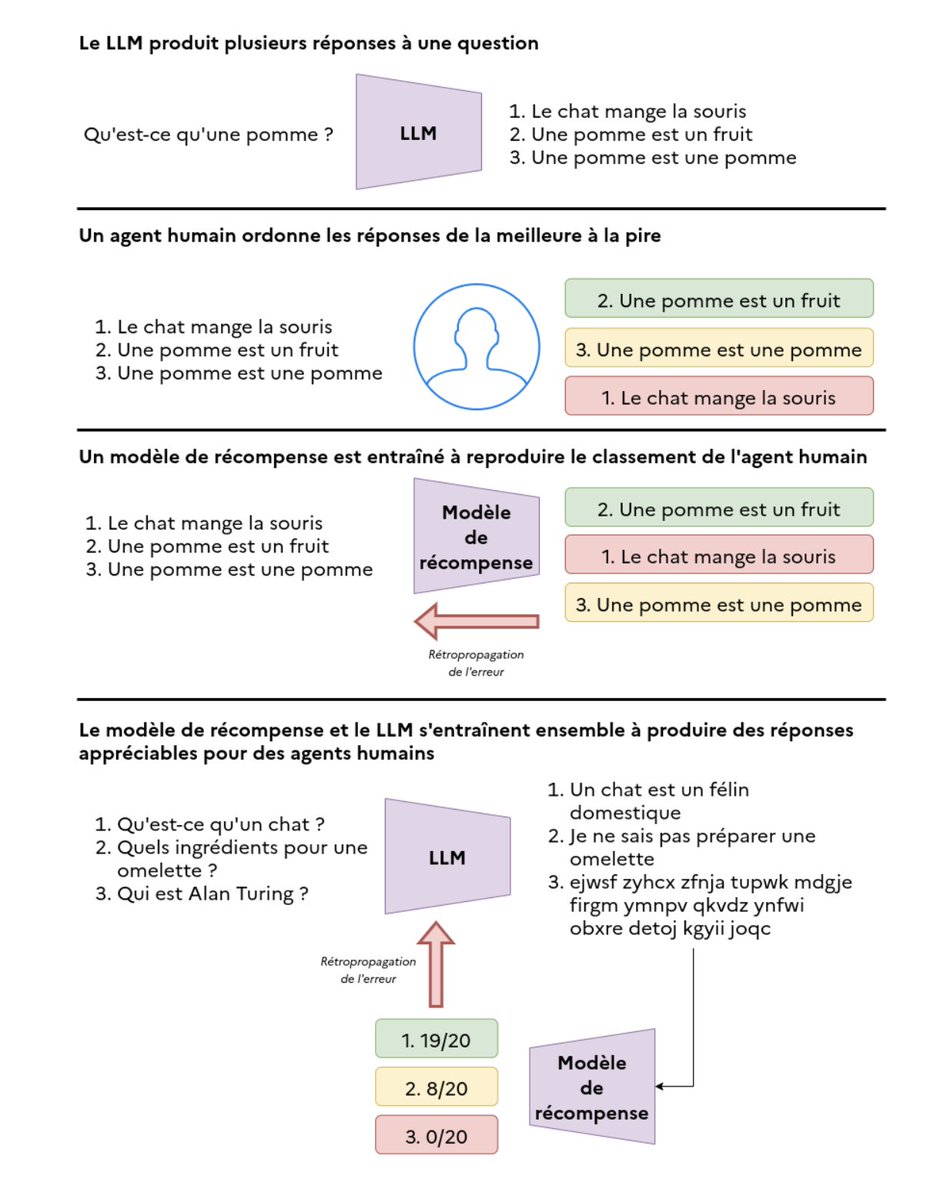

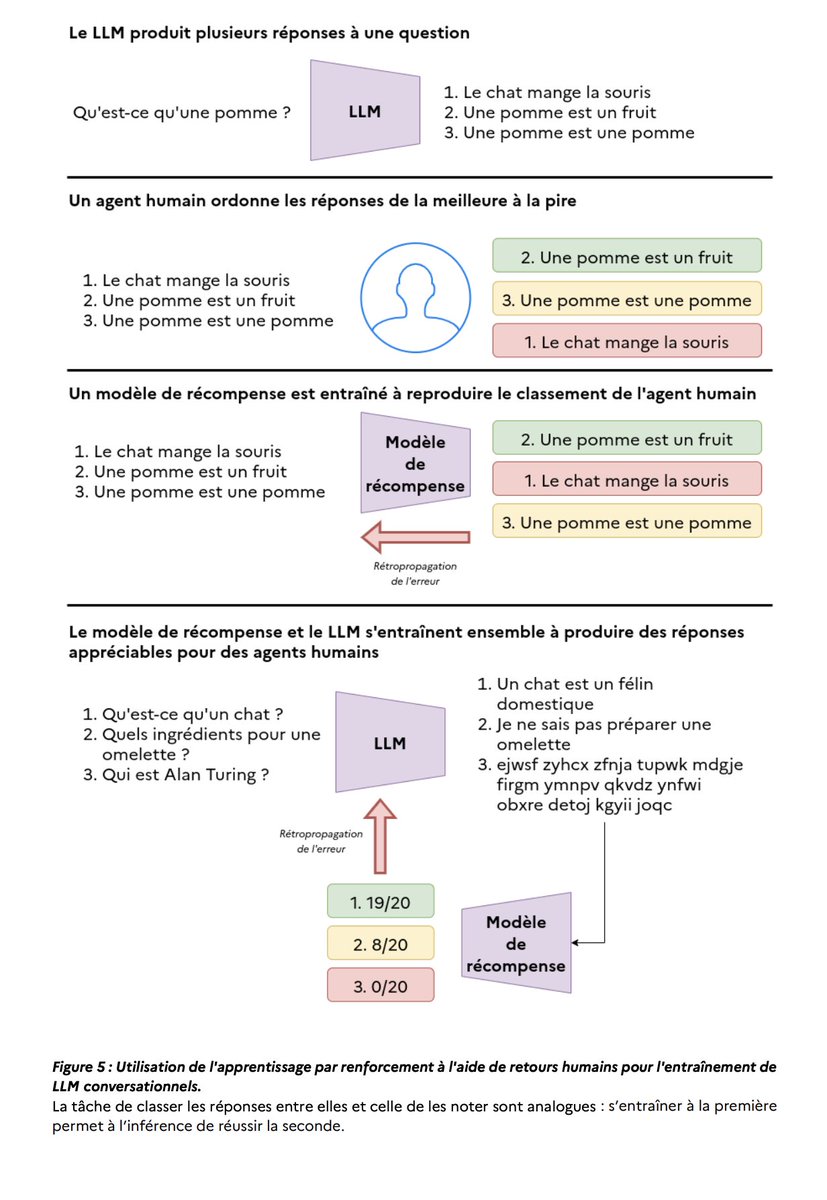

🎓 L'entraînement des LLM consiste à prédire le mot suivant d'une phrase en fonction du contexte. Les modèles sont récompensés pour des prédictions correctes et ajustent leurs paramètres pour améliorer leur performance. #Training 7/9

@jeffpillou - Jean-François Pillou

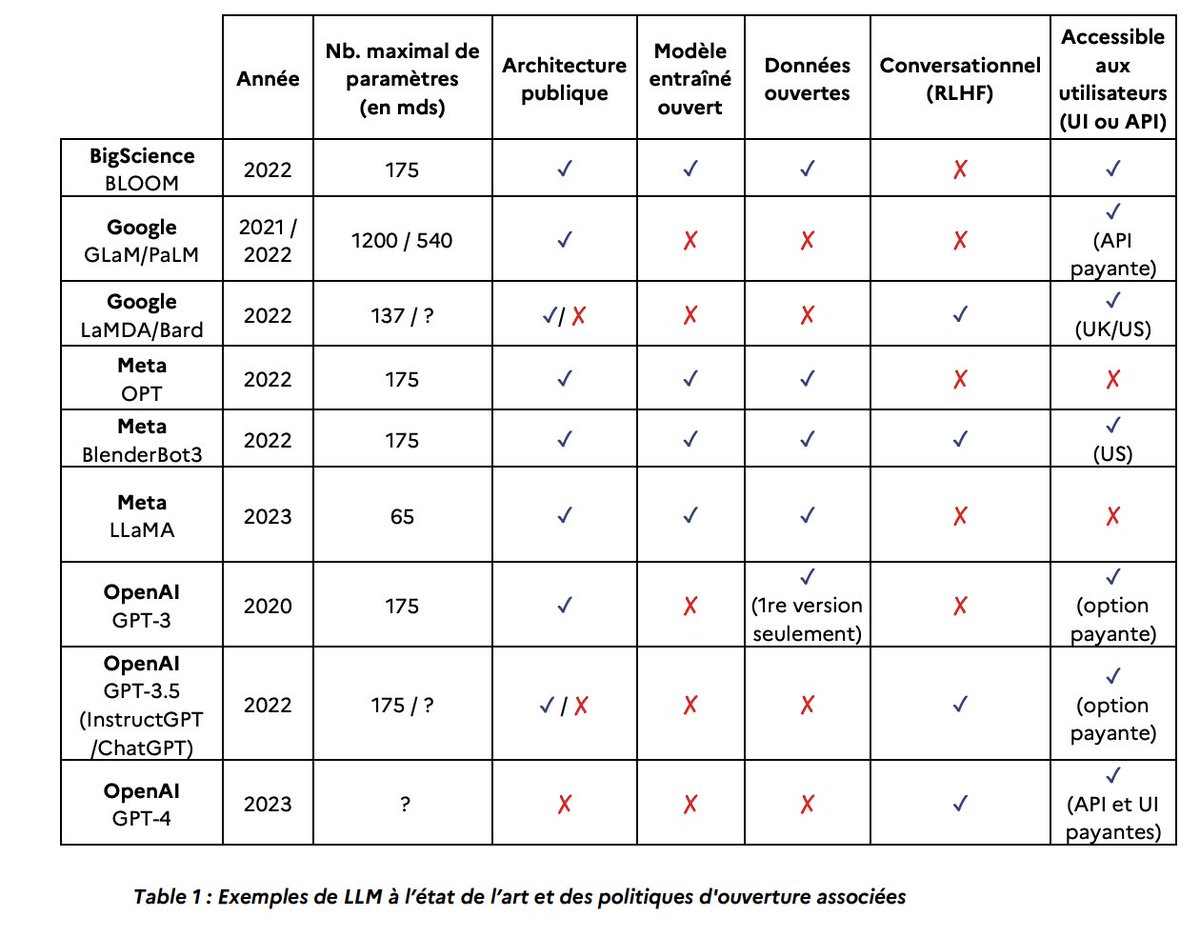

🚧 Les coûts d'entraînement et les risques liés à l'utilisation des LLM ont conduit certaines entreprises à limiter l'accès à ces modèles. Néanmoins, des chercheurs travaillent sur des LLM ouverts pour favoriser la collaboration et l'innovation. 8/9

@jeffpillou - Jean-François Pillou

Les LLM vont transformer de nombreux domaines, en fournissant des réponses synthétiques en langage naturel. Cependant, la régulation de ces technologies doit assurer protection, transparence et souveraineté. #AI #LLM 9/9 Source: https://peren.gouv.fr/rapports/2023-04-06_Eclairage%20sur_CHATGPT_FR.pdf… https://www.peren.gouv.fr/rapports/2023-04-06_Eclairage%20sur_CHATGPT_FR.pdf